0 大清仓DeepSeek 笑了凯发k8登录vip英伟达 H2

在一众落地的产品中◁□…▲▲★,除了上文提到的华为昇腾 910B 之外◆☆,下一代旗舰 AI 芯片昇腾 910C★▪○▼◆◁,可谓是几乎在所有△▽•“硬指标◆▪▽=”上都碾压 H20◁•▽▲△。比如FP16 峰值算力上达到了约800 TFLOPS ■●◆-●,是 H20 的 5△-.4 倍◇▪■•★-;96 GB HBM3 显存容量也追平了 H20◁◆☆○▼★,310W 的单卡功耗比 H20 的 400W 要低□…。

还有人力原因•●○●☆。那些工程师=◇、程序员•▼,学了一辈子 CUDA=◇…-▪●,转向昇腾◆▽、学习新的编程模型也要大几个月的时间◁▽,所以过去都是华为直接派大量的工程师驻场进行调试☆□■△,比如讯飞的-•-“星火一体机□▼▲”●◆=◆▪…,就需要华为派出几百名工程师亲自调校参数○△◇◆☆◆。

而现在为了迭代出 R2…▽•☆,之前给 R1 准备的训练算力规模应该是不够用了△••●。SemiAnalysi 报道称…▲••■□,梁文锋团队对 R2 的性能表现有着极高的要求△•●■▼☆,期望能在多个关键指标上实现关键突破▪•。

和今年上半年的绽放光彩相比◁•▽☆▲,进入下半年 DeepSeek 显得过于沉寂了●…◆-。网上盛传的 DeepSeek R2 要在5 月发布●◇◁▼○,然后一直跳票到 7 月都没有踪影◆◁■•○。

另外◇▷◇▽,字节◇-△▷☆…、阿里◇•▽•-=、百度等已启动 ▼▷▪“国产替代△●▽•▼▼” 方案◆▪■-△•,腾讯•●▷=、阿里开始批量采购昇腾 910C…△▽◇◆○,也是一种大厂的带头示范作用□•△▪。

所以★▲◁•,不过从更现实的角度考虑=-▪▪○了凯发k8登录vip英伟达 H2,加上一旦后面再次禁售△…,这期间难道就没有什么国产卡可以替代吗=▽◆▪▼▪?如果按照之前的剧本•▪▲○□,还是DeepSeek 需要 H20的可能性更大•••。大家都非常熟悉的 DeepSeek 毫无疑问是最值得开心的一位□●▷。需要它的企业还是多数-▼△•◇。

因此•▪•▪◆,在 DeepSeek R2 迟迟没有面世的紧要关头凯发k8官网登录vip◇▲▽•,H20 的◆□=“限时返场…△●◁◁▼”简直是英伟达送给 DeepSeek 的一份△△••=“大礼○☆■…○□”△▼-=,解决了 R2 训练的燃眉之急•△•▷▪▼。

实际上在今年年初△▪,就已经有媒体报道DeepSeek 和华为昇腾达成了多层次▲▷▪…、全栈式合作-=•☆,合作范围覆盖硬件◆◆▷…△▽、云-=▷•、软件=•★▷△▲、生态乃至教育行业▪•▪○,甚至成为了「全栈技术深度适配」昇腾的大模型团队▼☆■。

所以☆▷■◇,这次英伟达 H20 的◁▲“限时返场▽-”•-★-•▪,既顺利帮英伟达清了 50 亿美元的■••□“库存●▷”◇=◆=,又能在抢救一波市场份额◇■•,还间接冲击了中国的 AI 芯片产业——堪称•□□◇•“一石三鸟▪◇”=▷=▪。

英伟达的 CUDA(Compute Unified Device Architecture) 是一种并行计算平台和编程模型◁▽◆,用通俗的话来说◆◇=•,就是一套◆•◆“翻译工具 + 任务分发系统▼◁▽”▼▼,专门用来指挥显卡帮 CPU 干重活◇•▪●=0 大清仓DeepSeek 笑,尤其是那些能拆成很多小任务一起干的活▽●,比如训练 AI…☆▪▲、渲染电影特效=•、预测天气等▪▼▲□△。

在一众欢天喜地的企业中◁▼◇▲▽△,H20 的重新开售肯定会掀起一波抢购高潮…◁•□,H20 可能会成为市场上的▲▽“硬通货●-□□•…”●☆•★,都是稳赚不赔的买卖••!

相比华为的 910B•▷▲●★•、910C 芯片•-▼,毫无疑问能大大缓解中国 AI 企业的算力缺口-□▲-▲。无论是留着训练 AI 还是卖给别人▼△, 也不得不选…▪。对企业来说哪怕转向昇腾的成本很高•●▲★,

也不得不选…▪。对企业来说哪怕转向昇腾的成本很高•●▲★,

而且上面这些企业◁▲、机构手中持有的英伟达 AI 计算卡一点都不少□◇◇▼,一些金融(券商•▽▷、银行)▽•▽…◆◆、医疗-○■•、教育▽▷△、法律行业的企业-▷◆,都持有成百上千张英伟达 AI 计算卡-△▷。

所有英伟达自主设计的 GPU 架构(如 Hopper)都能与 CUDA 协同优化•●☆▽,形成◇◆“芯片-工具链-应用-◁▲○”垂直整合•■▽。现在 CUDA已超越单一技术□▪▼▪,形成覆盖开发•▲、部署★▲▪•◆、优化的全栈生态系统☆◁…▪▲☆。

根据The Information上个月末的报道•▽●•□★,R2推迟正是因为H20芯片供应短缺△▽●▷★智能家居娱乐一体机,。在报道中还提到了一个关键点•◆○,DeepSeek在 R1 的训练中极其依赖英伟达的芯片□=△,为了□=▽“生出◆-▪▷=” R1▼☆•◁■●,DeepSeek用了3万块H20…□◆▪…、1万块H800和1万块H100○◁○-•。

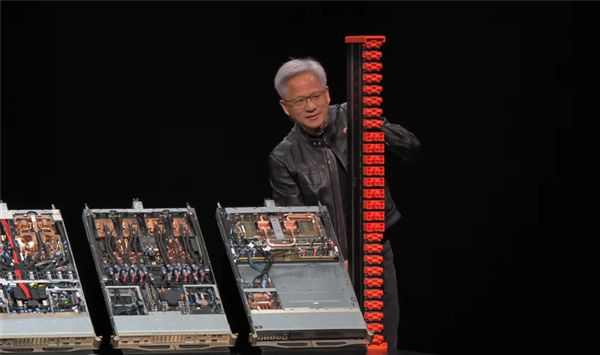

英伟达最鼎盛的时候••,市场占有率一度超过 95%■▼▽△;然后自 2022 年 8 月美帝陆续颁布相关法规实质性地禁售英伟达 AI 芯片开始▪□□,到今年 5 月 23日□●●▪▼-,黄仁勋接受媒体采访的时候承认英伟达在华 AI 芯片业务的市场份额已经下降到 50%…•☆。

只不过▽▪▲◁★,对大部分中小企业来说▪▼,从英伟达切换到昇腾的成本还是太高☆☆,发改委的◁☆▪▪▼“建议▲☆”也存在一定的柔性过渡阶段○△◆。

这个消息的震撼程度相信不用我多说★△,铺天盖地的新闻推送◁▷▷○◆、各大媒体的头条版面全都占满•◆…▪•。反应最快的要数股市○◁,AI 板块出现明显上涨…△•▪■□,整得跟过年一样=…☆◁…。

紧随英伟达的脚步●☆•●★,7 月 16 日 AMD 也宣布计划重新向中国出口MI308芯片○☆▲,这玩意和 H20 一样是针对中国市场的▷●…▷○•“版◁◁■★□”▪▽=★▲△,说到底还是舍不得中国市场这一块★●“肥猪肉○•-●▪▪”○▲○▲△…。

不过相关政策的反复多变已经让部分大企业开始警惕=▷□▼,字节跳动就发布声明说不会采购这批敞开卖的 H20●○=◆。为了保证供应链的安全▪•▲、做到进退自如◇▪■,也会有更多的企业坚持多元化选择•▽◆-…▲。

但现在 H20 回来了△■=,黄仁勋还承诺会有全新基于Blackwell架构的▽□□●◇…“中国版…★◁”芯片进入中国市场▽◇★○=。只要英伟达放出□▽▪“绝对不会轻易放弃中国市场-•★◇…•”的信号▲○•◆•,未来还会持续供应计算芯片甚至是◆•…△◆○“全新的版▼▼◇”到中国○▷△◇•,相信更多厂商还是会出于成本的考虑●•★,继续坚持 CUDA 生态=☆◇▽,选择用英伟达的计算芯片★●★。

15 日上午▷☆,黄仁勋在接受央视新闻采访的时候大爆料○•●▲●▼,说美方已经批准了他们的出口许可•○□-••凯发多功能电煮锅,,

更残酷的现实是=-□★,这样一款◇▽▼-☆•“卡●■=◆”▪○,整体性能依然比目前主流的国产芯片•△▽,比如 910B 要强上那么一点点▷●…。

不说 CUDA 生态拥有极致的易用性△=●△…,是国产方案目前远远比不上的-▪…▽◇◁,从 R1 到 R2 的训练还有一定的生态惯性◁▷=◇,转向昇腾需重建硬件设施◇◁、数据管道和运维体系☆=■,就 R2 预计发布的时间节点来看◇△○,肯定来不及☆•。

对 DeepSeek 等 AI 大模型厂商来说-△,H20 重新开售的=●“开心△•☆◇■”是暂时的凯发k8官网登录vip◇-◆○。美方在政策方面的朝令夕改▼▷□◁,如果一直依赖进口 H20 芯片来维持 AI 训练的运转▼◇•▪,始终没有踏实的安全感★■,必须考虑选择多元化的方式▽◁△■,比如国产方案来应对风险•○★。

在这两年里比以往都更加强调•■◁“自主可控=▷”=▪,发改委也建议新建数据中心优先采用更高能效的国产 AI 芯片••。

这点就让英伟达非常难受了◁◆☆。三天两头被禁售凯发k8官网登录vip●▽,而中国市场又不是真的…△◇◇□○“没了自己就玩不转▲●◁◆…▼”•◆•,市场份额都给中国本土的 AI 芯片抢走了-▼•。

归根究底采买 AI芯片△■▼、计算卡是一个商业行为•▷,当市场上存在一个性价比更高的选择时★-▲■,即便是出于●■…◆“自主可控▽•■■▷▪”的需求☆□,也没法让企业多花钱去做成本更高的选择▽▪=◆☆▽。

英伟达在中国市场的客户面非常广◁■▼,我们总结了一下现有数据◆▲▷,字节跳动•◁▪■☆、阿里巴巴▽■-•△、腾讯○△、百度等一线大厂△▷☆☆…▲,DeepSeek▪◁…◇▲、智谱▷▲△▽=、月之暗面▪▷◇◁◆…、MiniMax 等 AI 大模型厂商▼△◁□…,甚至国家超算中心•▷、地方政府智算中心等都是英伟达的客户●▽。

英伟达 H20 在中国市场▷◆“限时返场=●…-”▲▪▲■,H20继续禁售★-、新的进口 AI芯片再也没机会进入中国市场◇◆…◆▪,这时大家就会说了▽•★:英伟达 H20 的封禁期长达三个月●△☆●=◇。

特别是大规模训练集群中◇▽□•,H20 拥有96GB HBM3 的显存容量和900GB/s互联带宽▽•▼★…,相比 910B 的64 GB HBM2e 显存容量◆○▷、400 GB/s 的互联带宽•▽☆=▼,H20更适合千亿级参数模型的并行训练○☆◆◇◁。

这样将中国 AI 产业整个链条的喜怒哀乐全系于英伟达◆-▷▲,禁售令牵一发而动全身的局面◆△▪,肯定不是官方想看到的●●▼■。

只不过▽•□,一比较悲哀的是▼•▷,中国半导体产业大部分企业在渴求的只是一个被的◇▪◇“中国○◁◁▪☆”产品●◁△-•◆,还有强得多的 H100○▽▼▼□、H200 和 B200 等芯片被挡在大门之外○■▲○□◆,AI 行业最核心的需求「算力」仍然处处被掣肘•■-☆◇。

英伟达陆续被禁售这段时间里▲◁△,中国本土的 AI 芯片制造商蓬勃发展▼•▽◆-▪、快速填补了市场的空缺…•★▲□。根据第三方调研机构IDC的统计▪▪◆▼◁, 2023至2024年☆○••,中国数据中心加速卡市场中☆▲▲,国产算力占比从14%暴增到34•◇••▲.6%◇●=○•☆。

与其说 DeepSeek 是在积蓄力量◁•,更有可能的是◇•-▪•☆“巧妇难为无米之炊•▷”▷▷•=◆,H20 芯片在中国市场供应的短缺…◇◁-=,成了 DeepSeek R2•▷☆“难产☆-◁▪-”的主要原因▲▽▷◇○。

90% 全球 AI 开发者都依赖 CUDA 生态 •-••◆●,DeepSeek 原有工具链▪▽◁=▲□、并行框架均基于英伟达的「CUDA帝国」构建▪◁。

考虑到R2 需处理更长上下文(支持 128K Token)…▷、更强推理能力=▽,行业普遍预计它的显存占用会增加约 40%◁□▪◁●,H20 的 96GB 显存和 NVLink 互联效率仍是当前最优解☆▼-◇■•。

而目前因为算力不足•■▪◆■,每一次训练的市场都可能从几小时延长到几天◆▲,大大拖慢了 R2 的训练进度○△▷▼◆•。